在台灣的科技發展中,人工智慧(AI)正如一顆璀璨的明珠,吸引著各界的目光。然而,隨著AI應用的日益廣泛,對於計算能力的需求也隨之增加。這時,高帶寬記憶體(HBM)的重要性便凸顯出來。

想像一下,一位醫生正在利用AI輔助診斷,透過大量的醫療數據快速分析病患的狀況。如果沒有HBM的支持,這些數據的處理速度將會大幅減慢,影響診斷的準確性與效率。HBM提供了更高的數據傳輸速率,讓AI能夠在瞬息萬變的環境中迅速反應,從而提升決策的質量。

在台灣,隨著智慧城市、智慧醫療等領域的蓬勃發展,HBM的需求將愈加迫切。投資於HBM技術,不僅能提升AI的運算能力,還能為台灣的科技產業注入新的活力,讓我們在全球競爭中立於不敗之地。因此,了解並重視HBM的價值,將是推動台灣AI發展的重要一步。

文章目錄

AI 浪潮下的記憶體革命:HBM 如何加速台灣 AI 發展?

各位台灣的科技朋友們,大家好!身為一個在竹科打滾多年的老工程師,我親身經歷了台灣半導體產業的起起伏伏。還記得當年,我們為了提升晶片效能,絞盡腦汁優化製程、改良設計。如今,AI 浪潮席捲全球,記憶體技術也迎來了前所未有的變革。這次,我們要聊聊的是 HBM,也就是高頻寬記憶體,它如何成為台灣 AI 發展的關鍵推手。

想像一下,你是一位熱愛玩遊戲的玩家,你的電腦配備了頂級的顯示卡,但遊戲載入速度卻總是慢吞吞,畫面也偶爾卡頓。這就像 AI 運算,強大的處理器需要快速、大量的資料餵養,才能發揮其潛力。傳統的記憶體就像是狹窄的道路,資料傳輸速度有限,而 HBM 就像是拓寬的高速公路,能讓資料快速湧入 AI 處理器。這也意味著,台灣的 AI 產業,從雲端伺服器到邊緣運算,都將因為 HBM 的加持,迎來更快速、更高效的發展。

那麼,HBM 究竟是如何加速 AI 發展的呢?簡單來說,HBM 具有以下幾大優勢:

- 高頻寬: HBM 的資料傳輸速度遠超傳統記憶體,能滿足 AI 運算對資料量的巨大需求。

- 低功耗: 雖然效能提升,但 HBM 的功耗卻相對較低,有助於降低伺服器的運營成本。

- 高容量: HBM 的容量可以做得很大,能儲存更多的 AI 模型和資料。

根據 TrendForce 的研究報告顯示,2024 年 HBM 市場規模預計將成長超過 60%,這也反映了 HBM 在 AI 領域的重要性。此外,根據工研院的分析,台灣在半導體產業鏈中具有獨特的優勢,包括晶片設計、製造、封裝測試等環節,這使得台灣在 HBM 的發展中扮演著關鍵角色。

台灣的半導體產業,一直以來都是全球的領頭羊。如今,隨著 AI 時代的到來,HBM 將成為台灣產業再次騰飛的引擎。讓我們一起期待,台灣的 AI 產業,在 HBM 的助力下,創造出更多令人驚豔的成果!

解構 HBM 技術:深入剖析其架構與效能優勢,助您掌握 AI 運算關鍵

身為一個在竹科打滾多年的老工程師,我親眼見證了台灣半導體產業的崛起與蛻變。還記得當年,我們為了提升晶片效能,絞盡腦汁優化製程、堆疊電晶體。但隨著AI浪潮席捲全球,傳統記憶體架構的瓶頸日益顯現。這幾年,我特別關注HBM(High Bandwidth Memory,高頻寬記憶體)技術,它就像是AI運算的「超級高速公路」,讓資料傳輸速度大幅提升,為AI模型的訓練和推論帶來了革命性的變化。我親身經歷過,在處理大型資料集時,HBM的效能提升簡直是天壤之別,這讓我對台灣半導體產業的未來充滿信心。

HBM之所以能成為AI運算的關鍵,主要歸功於其獨特的架構設計。傳統的DRAM(Dynamic Random Access Memory,動態隨機存取記憶體)與GPU(Graphics Processing Unit,圖形處理單元)之間,資料傳輸需要經過較長的距離,造成延遲。而HBM將多個DRAM晶片垂直堆疊,透過矽穿孔(Through-Silicon Via,TSV)技術,形成一個高密度、高頻寬的記憶體模組,直接與GPU封裝在一起。這種近距離的連接,大幅縮短了資料傳輸路徑,降低了延遲,使得資料傳輸速度可以達到每秒數百GB,甚至數TB的驚人速度。根據TrendForce的研究,HBM的市場需求正隨著AI伺服器和高效能運算的需求而快速增長。

HBM的效能優勢,不僅體現在資料傳輸速度上,還體現在其功耗表現。雖然HBM的製造成本較高,但由於其高頻寬和低延遲的特性,使得GPU在處理大量資料時,可以更有效地利用記憶體資源,減少不必要的資料搬運,進而降低整體功耗。根據研究機構Yole Développement的報告,HBM的功耗效率遠優於傳統DRAM。此外,HBM的堆疊設計也使得晶片體積更小,更適合應用於空間受限的伺服器和高效能運算系統。這也符合了台灣在半導體產業中,追求高效能、低功耗、小型化的發展趨勢。

HBM技術的發展,離不開台灣在半導體封裝測試領域的深厚積累。日月光、矽品等封測大廠,在TSV、晶圓級封裝(Wafer-Level Packaging,WLP)等技術上,都取得了世界領先的地位。這些技術的成熟,為HBM的量產提供了堅實的基礎。根據工研院的分析,台灣在HBM的供應鏈中,扮演著關鍵的角色,從晶片設計、製造、封裝測試,到系統整合,都有著完整的產業鏈。這也使得台灣在全球AI產業中,佔據著舉足輕重的地位,並將持續推動AI技術的發展。

常見問答

為什麼AI需要HBM?

身為內容撰寫者,我理解您對AI與HBM(高頻寬記憶體)的疑問。以下針對常見問題,以專業角度提供解答,希望能幫助您更深入了解。

-

AI 為什麼需要 HBM?

簡單來說,AI 運算需要大量的資料,而 HBM 就像是 AI 的「超級高速公路」。傳統記憶體(如 DDR)的資料傳輸速度有限,無法滿足 AI 模型快速存取海量資料的需求。HBM 擁有極高的頻寬,能讓 AI 晶片更快地讀取和寫入資料,大幅提升運算效率,縮短訓練時間,並提升模型效能。這對於處理複雜的 AI 任務,例如自然語言處理、影像辨識等,至關重要。

-

HBM 與傳統記憶體有什麼不同?

主要的差異在於頻寬和容量。HBM 採用多層堆疊的設計,將多個記憶體晶片垂直堆疊在一起,大幅縮短資料傳輸路徑,進而提升頻寬。雖然 HBM 的容量可能不如傳統記憶體,但其高頻寬特性使其成為 AI 運算的理想選擇。就像是,HBM 像是專為高速賽車設計的跑道,而傳統記憶體則像是普通道路。

-

HBM 對台灣的 AI 產業有什麼重要性?

台灣在半導體產業擁有領先地位,尤其在晶片設計和製造方面。HBM 的發展與應用,對台灣 AI 產業至關重要。

- 提升競爭力: 台灣企業可以利用 HBM 打造更高效能的 AI 晶片,在全球市場上更具競爭力。

- 促進創新: HBM 的應用將推動 AI 模型的創新,加速 AI 技術在各行各業的應用。

- 帶動產業鏈: HBM 的需求將帶動相關產業鏈的發展,包括晶片設計、製造、封裝測試等,創造更多就業機會。

-

未來 HBM 的發展趨勢是什麼?

未來 HBM 的發展將朝著更高頻寬、更大容量、更低功耗的方向邁進。

- 頻寬提升: 新一代 HBM 將持續提升資料傳輸速度,以滿足更複雜的 AI 模型需求。

- 容量擴大: 隨著 AI 模型規模的擴大,HBM 的容量也將持續增加。

- 功耗優化: 降低功耗是 HBM 發展的重要目標,以提升能源效率。

最後總結來說

綜觀AI發展趨勢,HBM已成關鍵。台灣身為半導體重鎮,應積極佈局HBM技術,鞏固產業優勢,方能在全球AI浪潮中站穩腳步,持續領先。 本文由AI輔助創作,我們不定期會人工審核內容,以確保其真實性。這些文章的目的在於提供給讀者專業、實用且有價值的資訊,如果你發現文章內容有誤,歡迎來信告知,我們會立即修正。

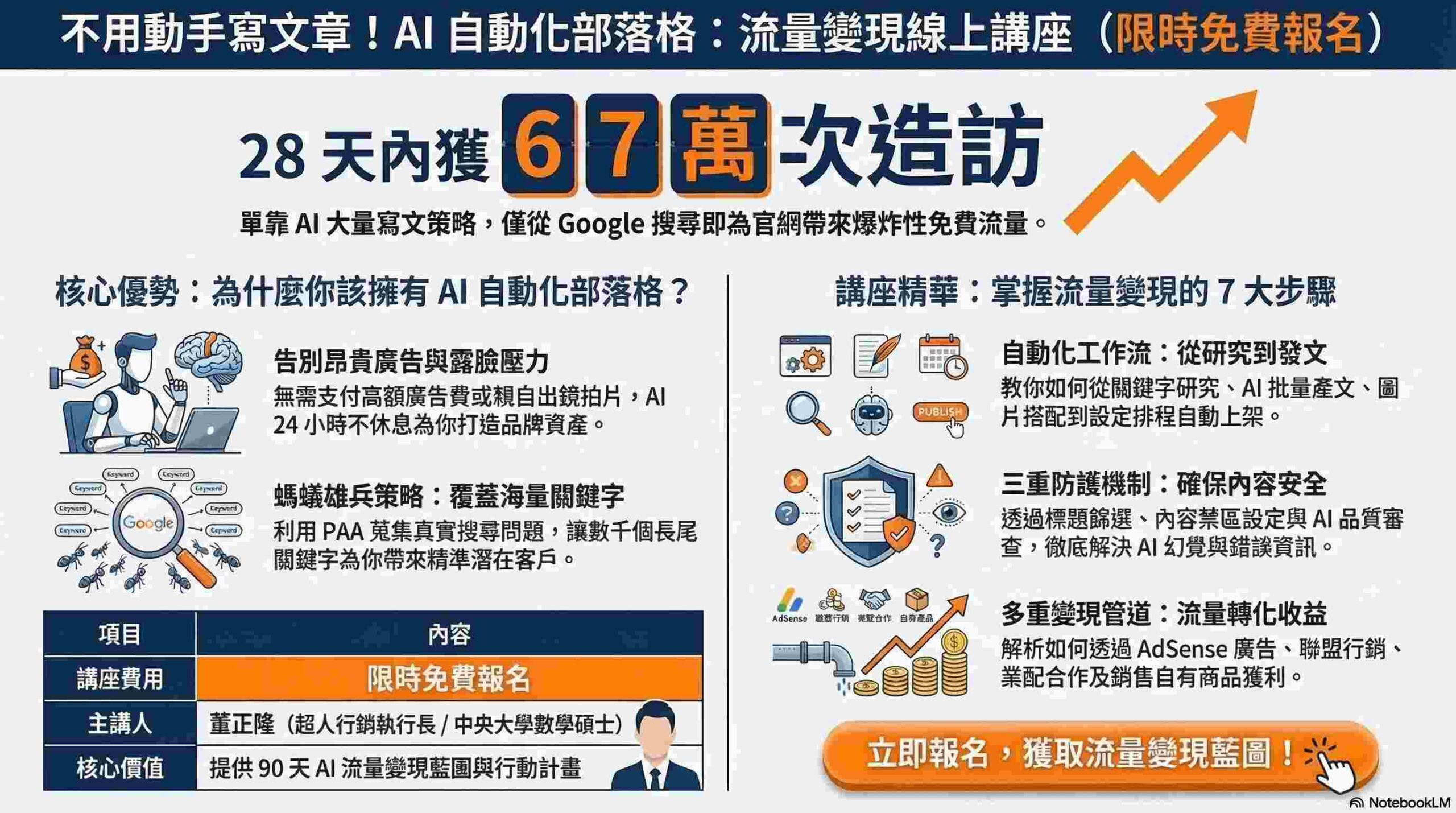

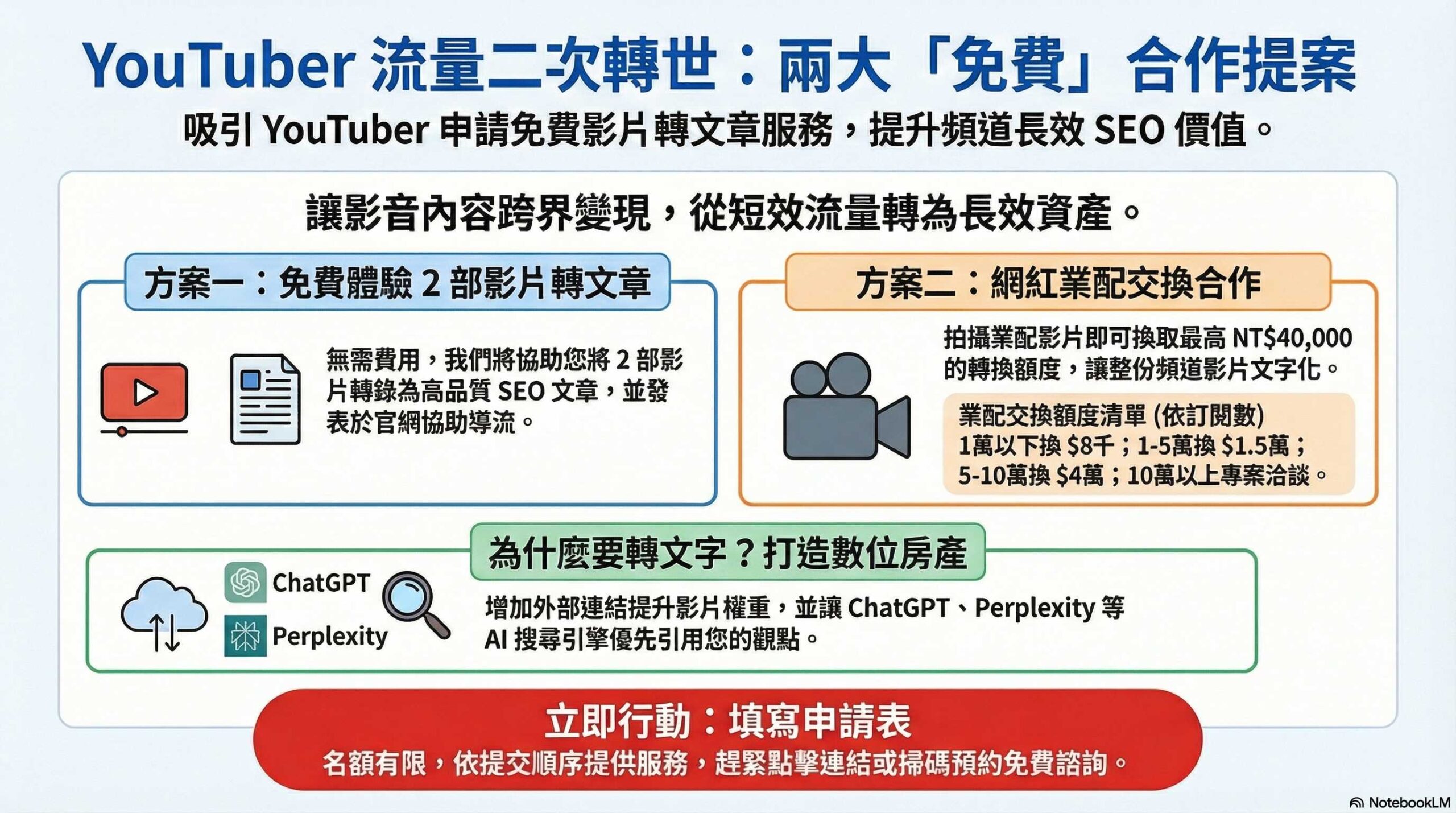

中央大學數學碩士,董老師從2011年開始網路創業,教導網路行銷,並從2023年起專注AI領域,特別是AI輔助創作。本網站所刊載之文章內容由人工智慧(AI)技術自動生成,僅供參考與學習用途。雖我們盡力審核資訊正確性,但無法保證內容的完整性、準確性或即時性且不構成法律、醫療或財務建議。若您發現本網站有任何錯誤、過時或具爭議之資訊,歡迎透過下列聯絡方式告知,我們將儘速審核並處理。如果你發現文章內容有誤:點擊這裡舉報。一旦修正成功,每篇文章我們將獎勵100元消費點數給您。如果AI文章內容將貴公司的資訊寫錯,文章下架請求,敬請來信(商務合作、客座文章、站內廣告與業配文亦同):[email protected]